2026/4/11

AIが事故を起こしたら?経営者が負う『法的責任』の正体と回避する3つの基準

⚡ Executive Summary(30秒でわかる要点)

- 【責任の所在】 AIが起こした事故の賠償責任は、開発メーカーではなく「利用する自社」に帰属します。特に人のチェックを介さない「丸投げ型(代替型)AI」では、経営者の注意義務は「個別の操作」から「業務プロセス全体の設計・運用」へと重みを増します。

- 【財務インパクト】 権利侵害や事故が発生した場合、損害賠償だけでなく、事業停止による売上逸失(年商の数%規模)や、長年築き上げた「企業の信頼」という無形資産の毀損という甚大なリスクが顕在化します。

- 【経営者のアクション】 AI導入を承認する際、それが「補助(人が確認)」か「代替(AI任せ)」かを明確に区分してください。後者の場合は、「業界標準の精度を満たしているか」および「継続的なモニタリング体制」が予算化されているかを厳格に確認すべきです。

AI導入を「効率化」の言葉だけで片付けていませんか?

「AIを導入すれば、人件費を削り、業務スピードを劇的に上げられます」。現場やITベンダーから、このような威勢の良い提案を受けている経営者の方も多いでしょう。年商10億、30億と事業を成長させてきた皆様にとって、生産性向上への投資は避けて通れない道です。しかし、その投資の裏側に潜む「法的責任という名の見えない負債」を、正しく評価できているでしょうか。

私が多くのオーナー経営者様からご相談を受ける中で感じるのは、「AIが事故を起こしても、それはソフトを作ったベンダーの責任だろう」という根強い誤解です。しかし、現実は非情です。最新の法的解釈では、AIを利用して利益を得ている「利用者(自社)」が責任を負うべきという考え方が主流になりつつあります。これは、ITセキュリティを「丸投げ」にすることが、結果として会社を危機に陥れるのと全く同じ構造です。

例えば、以前お伝えした2026年のITセキュリティ激変。経営者の「丸投げ」が会社を滅ぼす理由でも触れた通り、テクノロジーのリスクを外部に転嫁し切ることは不可能です。本稿では、AI活用における責任の所在を、経営者が判断すべき「数字とリスク」の視点で、温かみのある専門家の立場から解説します。

「補助」か「代替」か。経営者の責任を分ける運命の分岐点

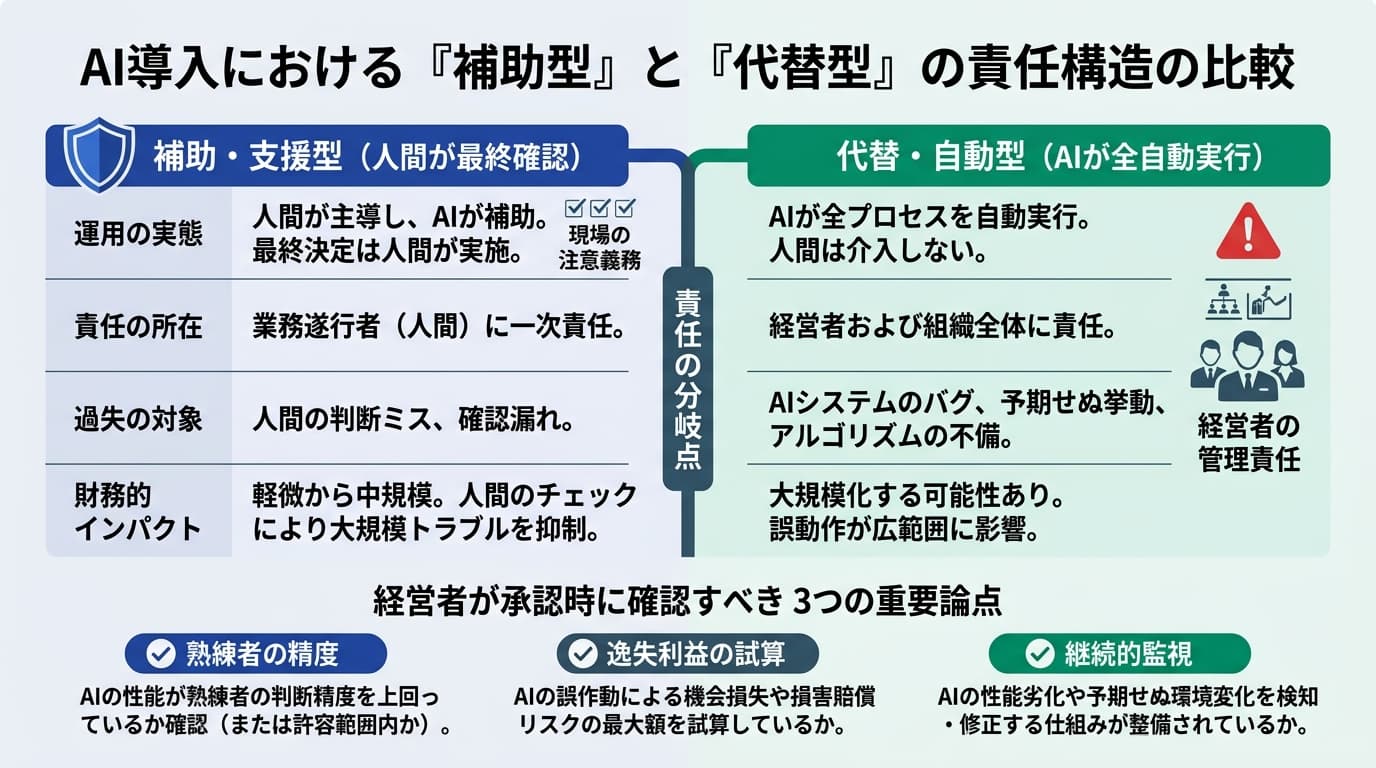

AIの活用には、大きく分けて2つの形があります。この違いを理解することこそが、経営者が負うべき「注意義務」の正体を明らかにします。一つは、AIの出した答えを人間が確認し、最終判断を下す「補助型」。もう一つは、人間の介在なしにAIが業務を完結させる「代替型」です。

特に注意が必要なのは、当初は「補助型」として導入したはずが、現場の忙しさから実質的に「ノーチェック(代替型)」で運用されてしまうケースです。この「実態としての丸投げ」こそが、法的な過失を問われる最も危険な領域となります。なぜなら、代替型AIにおける責任は、従来の「人の不注意」ではなく、「AIを組み込んだ業務プロセスそのものの設計ミス」として、経営陣の管理責任が問われるからです。

この責任構造の変化を視覚化すると、以下のようになります。経営判断の参考にしてください。

実践的な論点1:経営者が問うべき「精度の正体」

AIに判断を委ねる(代替型)場合、法的に免責されるための基準は「その業務における熟練者の作業水準と同等以上の精度」を確保しているかどうかにあります。例えば、製造ラインの検品AIを導入する場合、その精度がベテラン社員の平均を下回っていれば、事故が起きた際に「不適切なプロセスを導入した」と判定されるリスクが高まります。

経営者の皆様は、投資案件を承認する際に、ぜひ現場へ次の3点を問いかけてみてください。(1) AIの精度は具体的に何%か、(2) それは今の熟練社員の精度と比べてどうなのか、(3) 精度が落ちた時にすぐ気づく仕組みはあるか。これらが曖昧な投資は、将来の大きな「不確実性」を抱え込むことになります。

実践的な論点2:財務と事業継続の視点

AI事故のリスクは、単なる賠償金の支払いだけでは済みません。例えば、配送ルートを自動生成するAIが、通行不可能な狭い道へ車両を誘導し、大事故を起こしたとしましょう。この時、会社が負うのは修理費だけではありません。「配送遅延による取引先への違約金」や、「安全管理不備による営業停止処分」といった、事業の根幹を揺るがす事態に直結します。

私が支援したある企業では、AI導入によるコスト削減が年3,000万円見込める一方で、万が一の事故による売上逸失リスクを試算したところ、わずか1週間で5,000万円を超えることが分かりました。このような「得られる利益と、失うリスク」の冷静な比較こそが、孤独な決断を迫られる経営者にとっての「守りの盾」となります。

事例に学ぶ:画像生成AIと「信頼」の失墜

年商30億円規模のアパレル企業の事例です。広告制作費を抑えるため、画像生成AIでモデル画像を制作しました。担当者は特定の誰かを真似たわけではありませんでしたが、出来上がった画像が偶然にもある著名なタレントに酷似しており、パブリシティ権侵害で訴えられる事態となりました。

ここで重要なのは、「意図していなかった(悪気はなかった)」という言い訳が通用しにくい点です。法的には、AIが既存のデータを学習している以上、似たような画像が出る可能性を予見し、確認する義務が利用者にあります。特に商売目的であれば、そのチェック体制の不備は厳しく問われます。

このリスクを回避するための判断基準を、フローチャートにまとめました。

この事例の教訓は、AIによる「自動化」は「確認の省略」を許すものではない、ということです。むしろ、AIというブラックボックスを導入するからこそ、「最後は人間が責任を持つ」という内部統制の価値が上がります。これは、Blogで繰り返しお伝えしている、テクノロジーとガバナンスの調和そのものです。

経営者が握るべき「AIガバナンス」という名の羅針盤

AIは、成長企業にとって強力な武器ですが、扱いを誤れば自らを傷つける「諸刃の剣」にもなります。経営者の役割は、AI導入を怖がって止めることではありません。AIがもたらす「効率性」という果実と、「法的責任」というリスクを、同じ天秤にかけて正しく評価することです。

具体的には、次回の予算会議や進捗報告の場で、「リスクアセスメントの結果」と「運用時のチェック体制」を報告に含めるよう指示を出してください。数字の裏側にある論理を突き詰めることこそが、会社と社員を守る経営者の真骨頂です。また、これからの時代はAIだけでなく、GX(グリーントランスフォーメーション)などの外部環境変化も経営を揺さぶります。「GXはボランティア」は倒産リスク。2026年、補助金と取引のルールが激変するで述べたような、多角的なリスク管理が求められています。

今回お話しした内容は、AI利活用における責任の全体像の一部です。貴社の事業内容や組織規模に合わせた、より具体的なリスク対策やロードマップの策定については、ぜひ一度専門家として私にご相談ください。共に、安心できる成長の形を探っていきましょう。

自社の場合はどうなのか、気になりませんか?

本記事の内容は一般論です。貴社の個別事情に合わせた分析は、初回無料相談にてお伝えしています。

無料計算ツールをご活用ください

経営判断に役立つシミュレーションツールをご用意しています。

登録不要ですぐにご利用いただけます。